对于GPT-2模型的学习(未完待续)

GPT-2与BERT都是Transformer模型的衍生物,其中BERT是仅仅对Transformer模型中的encoder部分进行改造;而GPT-2是对Transformer模型中的decoder部分进行改造

对于Transfoemer的理解可以看之前看这里,BERT的理解可以看这里,接下来我们将详细介绍GPT-2,我们将分为如下几个部分介绍:

- 整体模型:大致了解模型的整体结构

- Decoder详解:详解单个decoder中的计算原理

- GPT-2的应用:详解模型如何在实际中进行应用

整体模型

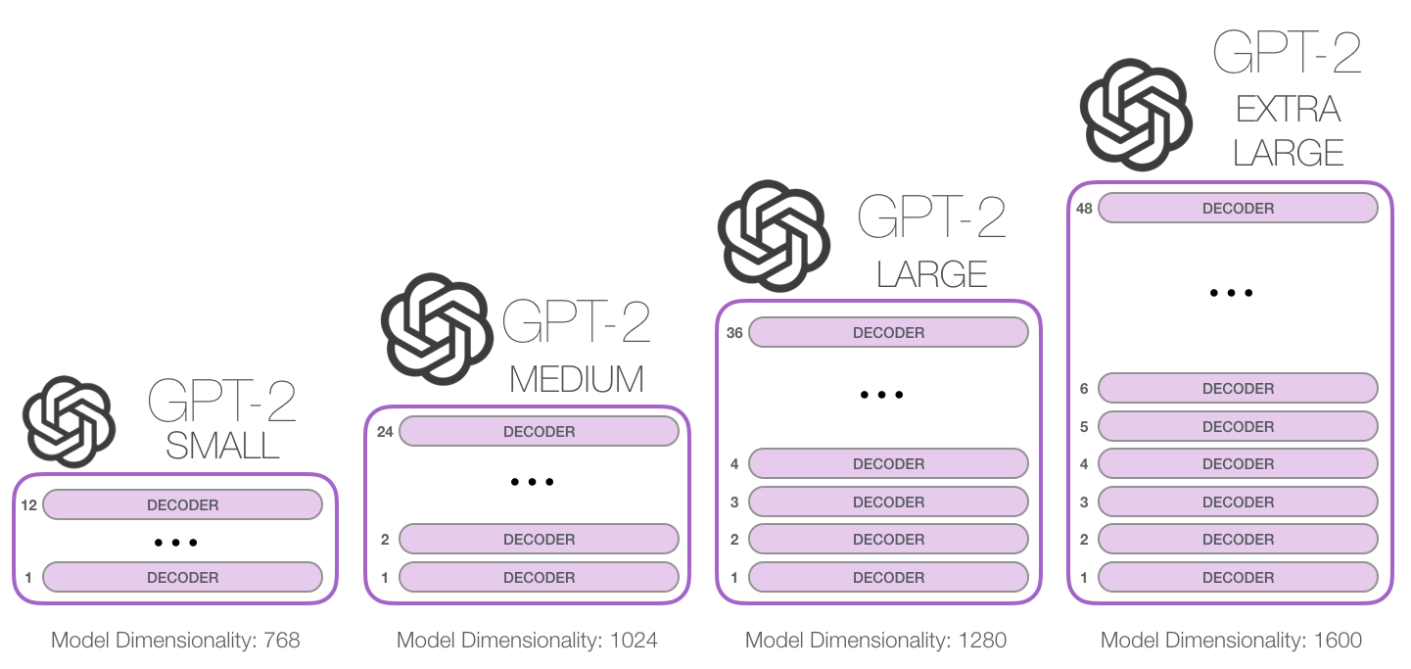

使用了Transformer的decoder部分,将多个decoder堆叠构成了decoder栈

对于GPT-2模型的学习(未完待续)